当AI系统在真实场景中落地,最大挑战往往不是模型能力本身,而是不确定性——模型在面对模糊边界、高风险决策或训练数据覆盖不足的场景时,往往以高置信度输出错误结果而不自知。人机协作(Human-in-the-Loop,简称HITL)正是为解决这一问题而生。

什么是 HITL?

HITL的核心思想很直观:在AI自动化流程的关键节点,系统性地引入人类判断。这不是全程让人参与,也不是完全放手让AI自主决策——而是在”AI最需要帮助”的时刻,让人类专家介入纠偏。

HITL 工作流解析

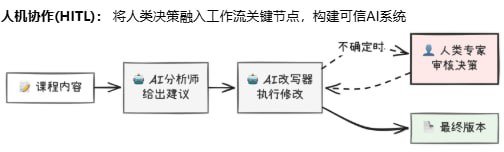

一个典型的HITL流程包含以下节点:初始输入(课程内容)→ AI分析师(给出建议)→ AI改写器(执行修改)→ 人类专家(在”不确定时”介入审核)→ 最终输出。

关键机制是不确定性触发:AI改写器在完成后会自我评估置信度,若结果在可接受范围内则自动流转;若判定为高不确定性,则主动向人类专家发起求助。这种条件触发确保了人类介入的精准性,而非低效地全程跟随。

为什么 HITL 是构建可信AI的关键?

HITL通过三个层面化解AI风险:安全护栏(关键节点设置人类审核关卡,确保高风险输出不被直接放行)、价值对齐(人类价值观注入决策过程)、持续进化(每一次纠偏都是高质量强化学习信号)。

HITL 的适用边界

HITL不适合:完全自动化的低风险任务、需要高速响应的实时场景、以及人类自身也无法判断的领域。适合的场景通常具有”容错空间小、边界模糊、后果重大”的特点——如医疗诊断辅助、法律文书审核、金融风控决策等。

结语

HITL代表了一种务实的AI落地哲学:承认AI不是万能的,在它最需要帮助的时刻让人发挥价值。灰(AI)→ 红(人类) → 绿(成果),三种颜色勾勒出可信AI系统的基本色。这不是对AI能力的否定,而是对AI局限的清醒认知与系统性应对。