评测驱动开发:如何用数据闭环让AI Agent越用越强?

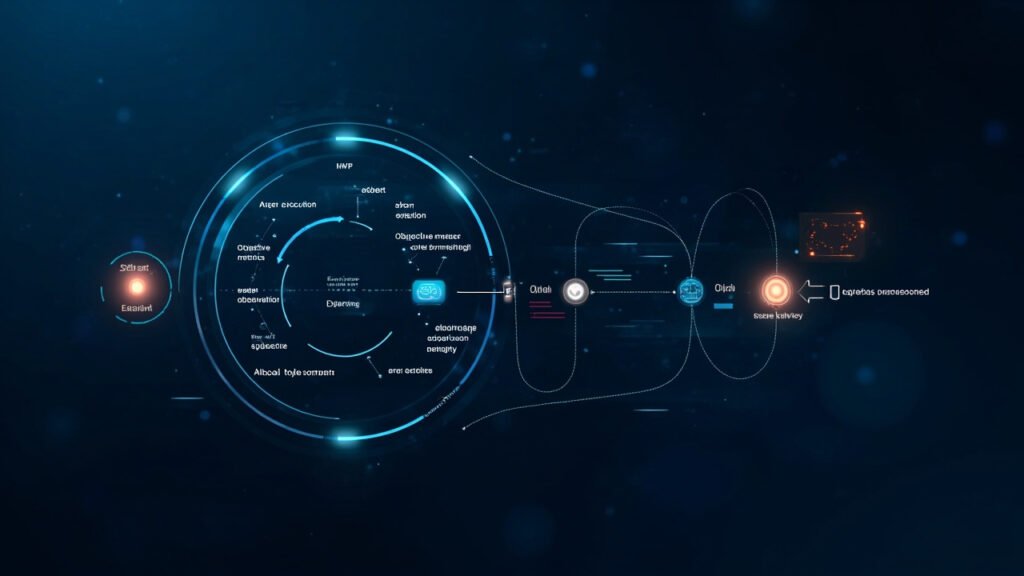

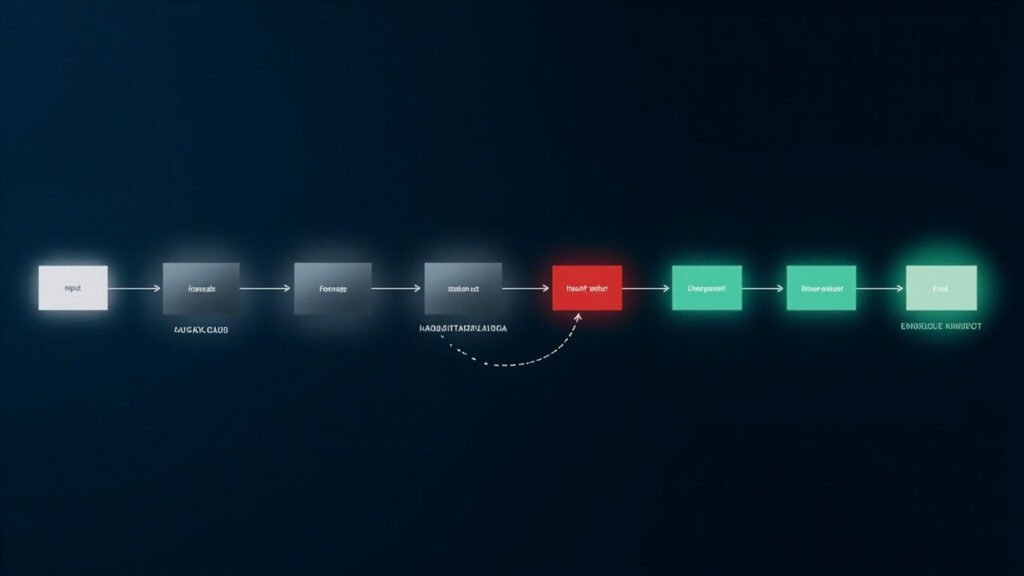

AI Agent 的开发有一个根本性问题:开发者往往难以判断 Agent 在真实任务中的实际表现——它到底做对了什么?做错了什么?下一次迭代该改进哪里?传统的方法是靠人工抽查和主观感受,但当 Agent 的能力边界逐步扩展时,这种”盲测”越来越不可靠。 ▲ 评测驱动开发(EDD)闭环:运行→提炼指标→多维度评测→反馈改进 EDD 核心:反馈闭环 EDD 的本质是一个持续迭代的优化闭环:MVP 启动 → 真实运行 → 观察错误与提炼指标 → 多维度评测 → 结果汇总 → 反馈改进。虚线箭头代表的就是这个反馈循环——它不是一次性流程,而是永续进行的迭代。 指标分为两类:客观指标(可运行性、格式合规、字数长度)直接自动检测;主观指标(准确性、数学逻辑、风格倾向)通过 LLM 评测和人工评测交叉验证。 为什么要区分主客观指标? EDD 的高明之处在于:用 LLM 做裁判来评测主观指标。GPT-4 或同类大模型可以扮演”评审官”角色,对内容的准确性、逻辑性、风格一致性给出评分。重要场景下依然保留人工评测通道,确保高风险错误不被漏过。 AgentScope 评测框架实践 AgentScope 给出生产级参考实现:输入课程基准 → 生成 Agent(产出章节草稿:标题、教学目标、代码示例、测验)→ 评审 Agent(独立审核)→ 五维度量化评分结果。生成与评审分离、主客观结合,让优化有的放矢。 EDD 的工程价值 从主观直觉到数据驱动:每一次迭代都有了客观的量化基准。 从全局盲测到定向改进:评测报告清晰指出 Agent 在哪些指标上表现不佳。 从单次交付到持续进化:Agent 可以在实际使用中不断积累评测数据,越用越精准。 结语 EDD 解决的不是”Agent 能力强不强”的问题,而是”团队能否看清 […]

评测驱动开发:如何用数据闭环让AI Agent越用越强? Read More »